站长之家(ChinaZ.com)4月16日 消息:EleutherAI最近发布了一种名为Pile-T5的新型T5模型,旨在解决原始T5模型在处理代码相关任务时的局限性,以及其分词器可能遗漏重要代码标记的问题。Pile-T5模型的推出标志着自然语言处理(NLP)在代码理解领域取得了重大进展。

模型特点

训练量增加:Pile-T5模型的训练量是原T5模型的两倍,达到200万步或2万亿步。这种大规模的训练使模型能够学习更丰富的语言模式和代码结构,从而提高其理解代码的能力。

新的预训练数据集:Pile-T5用新的LLAMA分词器取代了原始T5模型的预训练数据集。该分词器专门优化了代码和文本的混合输入,可以更准确地处理与代码相关的任务。

训练过程:在训练过程中,Pile-T5使用与原始T5相同的超参数和T5x技术。该技术允许模型在训练过程中更有效地利用数据,提高训练效率和性能。

下游微调任务:Pile-T5在微调下游任务时表现出显著的改进,尤其是在代码任务中。这表明Pile-T5在理解和生成代码方面具有更强的能力。

性能评估

SuperGLUE基准测试:Pile-T5在SuperGLUE基准测试中表现出色,甚至在token-matched设置中也大大超过了T5-v1.1。SuperGLUE是一项基准测试,用于评估模型在多个NLP任务中的性能,包括问答、自然语言推理等任务。Pile-T5的出色表现证明了其在这些任务中的强大能力。

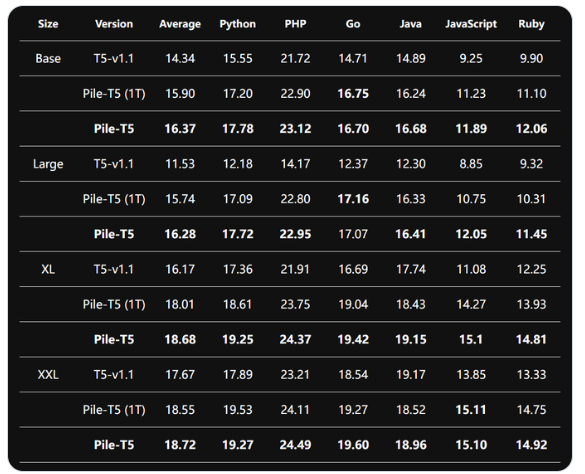

CodeXGLUE "代码到文本"子任务:Pile-T5在CodeXGLUE中"代码到文本"性能提升也显示在子任务上。CodeXGLUE是一种基准测试,专注于评估模型在代码理解和生成方面的性能。Pile-T5在这项任务中的改进进一步证明了它在代码相关任务中的优势。

模型下载地址:https://huggingface.co/EleutherAI/pile-t5-xxl

Copyright © 2013-2025 bacaiyun.com. All Rights Reserved. 八彩云 版权所有 八彩云(北京)网络科技有限公司 京ICP备2023023517号

本站文章全部采集于互联网,如涉及版权问题请联系我们删除.联系QQ:888798,本站域名代理为阿里云